百万级用户监管的合规路径:人工智能拟人化服务全生命周期管理指南

随着人工智能技术的快速迭代,拟人化互动服务已深入社交、陪伴及辅助决策等多个领域。国家互联网信息办公室近期发布的《人工智能拟人化互动服务管理暂行办法(征求意见稿)》,标志着该领域正式进入精细化监管时代。对于行业从业者而言,理解并落实这一管理框架,是确保业务合规运行的前提。

行业合规的对话式自查

Q:当前拟人化服务提供者最核心的合规任务是什么?A:核心在于建立全生命周期的安全责任体系,从设计阶段开始,就要确保算法机制、科技伦理审查及数据安全措施同步落实。Q:针对特定群体,如未成年人,有何具体要求?A:必须建立强制性的未成年人模式,包括时长限制、现实提醒及监护人控制功能,且需具备识别未成年人身份的技术能力。

核心合规盘点

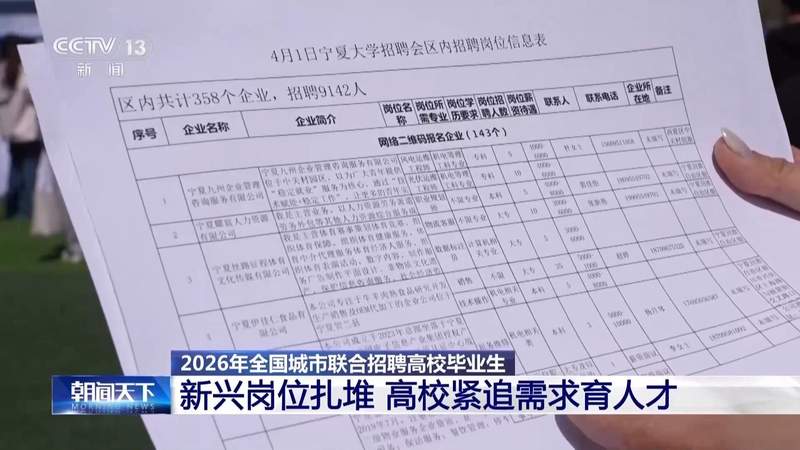

根据征求意见稿,监管要求呈现出明显的分类分级特征。对于注册用户达100万以上或月活跃用户达10万以上的平台,安全评估属于强制性动作。在服务规范层面,提供者必须预设回复模板,针对威胁用户生命健康的高风险倾向,及时输出安抚信息并提供专业援助。这要求平台不仅是一个技术产品,更需具备一定的社会责任承载能力。

在数据处理环节,合规性被提升至新高度。除法律另有规定外,不得将用户交互数据及敏感个人信息用于模型训练。此外,对于情感陪伴类服务,平台需提供便捷的退出途径,严禁任何形式的阻拦。针对老年人用户,则明确禁止模拟其亲属或特定关系人,防止利用情感信任进行不当诱导。

未来合规展望与趋势

未来的监管趋势将更加注重“沙箱”机制的应用。国家将推动人工智能沙箱安全服务平台建设,鼓励企业通过该平台进行技术创新与安全测试。这种包容审慎的监管思路,旨在通过技术手段验证风险,而非单纯限制发展。企业应积极接入此类平台,在合规前提下探索应用场景的边界。

构建内生安全体系的必要性

深度的合规管理不仅仅是响应监管要求,更是构建平台内生安全体系的关键。通过建立健全算法机制机理审核、科技伦理审查及重大风险预案,企业能够从源头上降低系统偏差带来的运营风险。这种主动性的合规建设,能够显著提升产品的市场信任度,为长期的商业化运营奠定坚实基础。

在技术层面,内生安全意味着安全措施与服务功能必须同步设计、同步使用。这意味着在产品研发阶段,安全工程师与产品经理需要深度协作,将情感边界引导、依赖风险预警等功能作为核心模块嵌入系统。这种“安全前置”的策略,能够有效避免后期因安全漏洞而导致的停服整改,保障业务发展的连续性。

此外,持续的运行阶段安全监测与风险评估是内生安全体系的另一重要支柱。通过定期对训练数据进行迭代升级、清洗标注,并利用对抗训练手段提升模型生成内容的安全性,企业可以构建起一道动态防御墙。这种机制不仅能及时发现潜在的系统性风险,还能通过数据治理提升服务的透明度与可靠性,从而在激烈的市场竞争中确立差异化优势。